Els límits de la tecnologia

Europa obliga a identificar els continguts creats amb IA

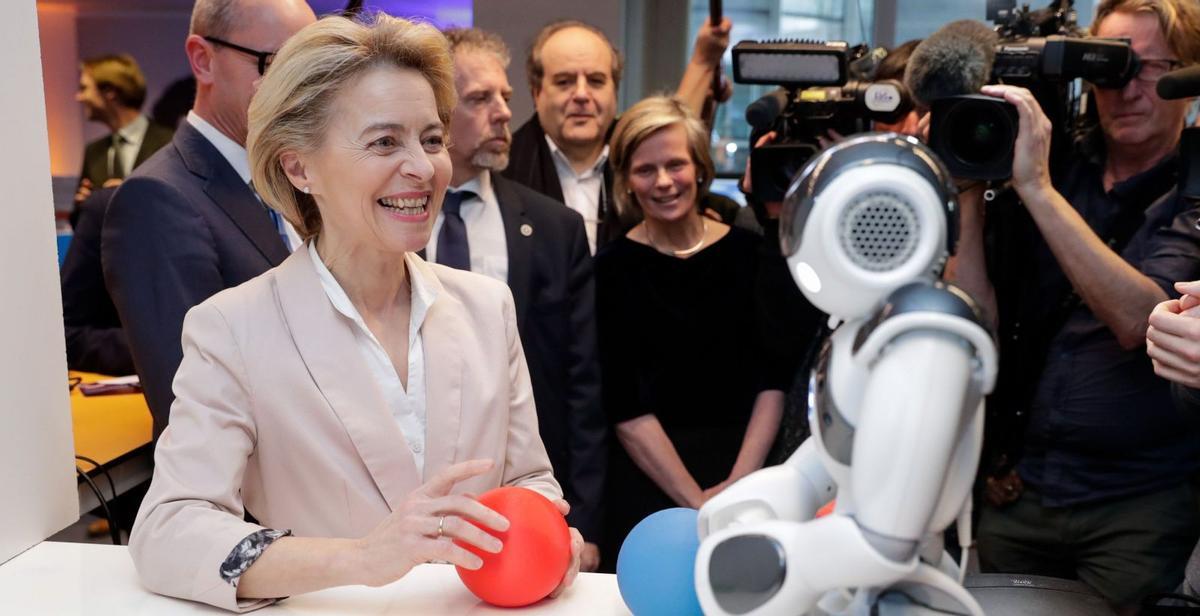

La regulació de la intel·ligència artificial a la UE que n'acota l'ús i la comercialització entra en vigor avui oficialment, després de tres anys d'intens treball

Marcar la pauta per resituar-se

L’esperada llei que regula la intel·ligència artificial (IA) a la Unió Europea (UE) ja és una realitat. Avui entra oficialment en vigor el primer marc jurídic del món que limita la comercialització i l’ús d’aquestes tecnologies partint dels seus riscos, una normativa que pretén fomentar el seu desenvolupament ètic protegint alhora els drets fonamentals dels ciutadans.

La llei és el resultat de més de tres anys d’intens treball. L’abril del 2021, la Comissió Europea va proposar per primera vegada elaborar un reglament "equilibrat" que permetés al bloc comunitari consolidar el seu lideratge tecnològic aprofitant els aspectes positius de la IA i evitant les seves conseqüències negatives. A finals del 2022, el text semblava ben tancat, però la inesperada febre per models generatius desencadenada amb el llançament de ChatGPT va obligar els legisladors a recosir-lo per evitar que quedés desfasat. Finalment, i després de mesos de negociacions dures, el Parlament Europeu va aprovar, el març passat, una mesura que des de Brussel·les s’ha definit com a "històrica".

Classificació per riscos

La pionera regulació vigent des d’avui estableix les bases per a la governança de la IA. Per a això, la classifica en quatre grups que estableixen obligacions més o menys estrictes segons els seus riscos. "Combina la defensa de la innovació amb la protecció dels drets bàsics [...] i suposa una capa addicional de protecció perquè som davant una eina molt poderosa", explica Ibán García del Blanco, exeurodiputat socialista que va participar en la seva redacció.

Aquesta sèrie de normes afectaran les empreses que desenvolupen aquestes tecnologies, però també els organismes públics, companyies i individus que les utilitzen. Les seves repercussions aniran més enllà de la UE i afectaran els proveïdors que, tot i operar fora de les fronteres comunitàries, introdueixin els seus sistemes al mercat europeu. Les multes pel seu incompliment poden arribar a un màxim de 35 milions d’euros o el 7% de la seva facturació anual mundial.

1 Risc inacceptable

La llei prohibeix rotundament els usos de la IA que violen els drets fonamentals. És el cas dels sistemes predictius policials, els que busquen manipular el comportament dels usuaris o els que categoritzen els individus per deduir-ne la raça, les opinions polítiques o l’orientació sexual.

2 Risc alt

Quan la IA pot tenir un impacte nociu en la seguretat de les persones i els seus drets individuals. És el cas del reconeixement facial, del qual s’han vist nombrosos i polèmics exemples recentment, del control biomètric laboral o dels sistemes predictius utilitzats per diagnosticar malalties i determinar ajudes públiques, crèdits bancaris o continguts educatius, entre d’altres.

Per a aquests usos, la llei preveu una sèrie d’obligacions estrictes que garanteixin la transparència dels algoritmes. "Els desenvolupadors d’aquests programes d’IA estaran obligats que les seves dades siguin precises i justes, però també a ser transparents en el seu disseny per explicar a les autoritats com han arribat a una conclusió i no a una altra", va dir el coponent de la llei i president de la comissió especial sobre IA, l’eurodiputat romanès Ioan-Dragos Tudorache, en una entrevista amb EL PERIÓDICO.

La normativa també exigeix que els organismes públics que adoptin sistemes d’IA d’alt risc hagin de portar a terme abans una avaluació d’impacte. La UE crearà una base de dades en la qual informarà els ciutadans de quins se serveixen d’aquestes tecnologies, fet que els donarà més poder per impugnar aquelles decisions algorítmiques que considerin injustes.

3 Risc limitat

En aquesta categoria s’hi inclouen els sistemes d’IA amb riscos associats a la falta de transparència. La llei es refereix principalment als anomenats models de propòsit general, les aplicacions d’IA generativa capaces de produir textos, imatges, àudios o vídeos partint de l’oceà contingut que extreuen d’Internet.

Les mesures dictaminades per la UE pretenen obligar els gegants tecnològics que comercialitzen aquests sistemes generatius –principalment Microsoft, OpenAI i Google– a adoptar canvis que aclareixin el funcionament dels seus productes i permetin als ciutadans estar més informats. Això permetrà saber si programes com ChatGPT, Gemini, Bard o Claude han sigut entrenats amb dades esbiaixades o amb obres protegides pels drets d’autor. També es traduirà en l’etiquetatge dels continguts creats amb IA mitjançant una marca d’aigua perquè els usuaris sàpiguen distingir quan el que veuen és real i quan és sintètic, per reduir així el risc de caure en la desinformació.

4 Risc mínim

En l’últim esglaó regulador hi figuren els sistemes que es poden desplegar sense obligacions addicionals a les establertes per la legislació vigent, ja que es considera que comporten un risc molt limitat. Per exemple, si una empresa utilitza IA per a processos de logística i gestió més eficient de la seva cadena productiva. Tot i així, el reglament de la UE convida les empreses que desenvolupen aquestes eines a comprometre’s voluntàriament a seguir codis ètics i de transparència.

Notícies relacionadesAplicació esglaonada

Tot i que és avui que la llei entra oficialment en vigor, les seves principals normes s’aplicaran de manera esglaonada al llarg dels pròxims tres anys, un marge que s’ha establert perquè tant el sector públic com el privat es puguin adaptar als canvis. Així doncs, els sistemes de risc inacceptable es prohibiran a partir del 2 de febrer del 2025, els sistemes d’IA generativa es limitaran des del 2 d’agost del 2025 i l’ampli gruix d’obligacions s’haurà d’acatar des del 2 d’agost del 2026. Les clàusules aplicades a la IA d’alt risc en productes ja regulats com l’aviació o els productes sanitaris esperaran fins al 2 d’agost del 2027.

Ja ets subscriptor o usuari registrat? Inicia sessió

Aquest contingut és especial per a la comunitat de lectors dEl Periódico.Per disfrutar daquests continguts gratis has de navegar registrat.

- Obligatori per llei La multa que et pot caure per no estar empadronat on vius

- Energies renovables El pàrquing de l’Alcampo de Sant Boi es transformarà en la instal·lació fotovoltaica més potent de l’àrea de Barcelona

- salut mental Els diagnòstics de TDAH entre els adults creixen en els últims anys

- Conflicte a Girona Una família denuncia que un home s’ha quedat d’ocupa en una casa que li van deixar a Llagostera

- LA VISITA BLAUGRANA AL COLISEUM Cinc anys amb un zero a Getafe

- Violència contra les dones Laura Palmer i la por que ens va quedar

- Transparència Hisenda vigilarà més les targetes: demanarà aquestes dades sobre els moviments

- Trump, la Lluna i més enllà

- Aquesta nit Gala dels premis Gaudí

- Premier league Haaland firma una inusual renovació amb el City fins al juny del 2034